Sinalização de IA não impediu confusão online

O recente episódio envolvendo um post gerado por inteligência artificial expôs falhas profundas na forma como o público identifica conteúdos digitais. O material trazia uma pequena etiqueta indicando uso de IA, contudo isso não impediu que milhões de usuários acreditassem que o conteúdo era real. A postagem viralizou justamente no período de escalada de tensão política entre Donald Trump e Nicolás Maduro, o que amplificou dúvidas, teorias e interpretações distorcidas.

Além disso, especialistas afirmam que a presença de uma simples marca de IA já não é suficiente para impedir enganos, porque o ambiente digital opera em velocidade extrema. Desse modo, a viralização ocorre muito antes de verificações concretas.

Por que o conteúdo viralizou tão rápido

Diversos fatores contribuíram para que o material se espalhasse com tanta intensidade. Entre eles:

- o clima geopolítico tenso, que aumenta a sensibilidade do público;

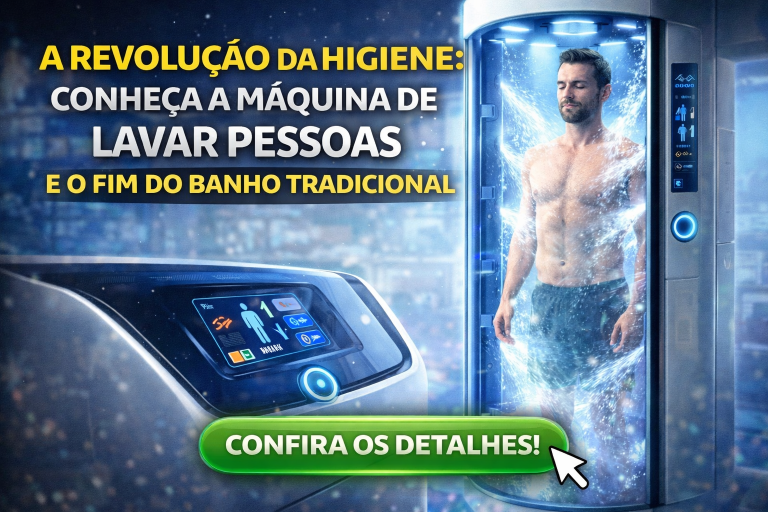

- a qualidade visual do conteúdo, já que modelos recentes criam materiais extremamente convincentes;

- a falta de hábito em analisar avisos de IA;

- o comportamento das redes sociais, que priorizam engajamento.

Mesmo com a etiqueta indicando uso de inteligência artificial, muitos leitores não perceberam a sinalização. Vários usuários relataram que acreditaram ser uma comunicação oficial, algo que reforça a fragilidade dos mecanismos tradicionais de aviso.

Tabela – Motivos que favoreceram o engano

| Fator | Explicação | Impacto |

|---|---|---|

| Contexto político | Conflito crescente entre Trump e Maduro | Público mais vulnerável à desinformação |

| Design convincente | IA gerou imagens e frases de alta precisão | Aumentou a credibilidade do post |

| Falta de atenção ao selo | Usuários não observaram o aviso de IA | Confusão sobre autenticidade |

| Algoritmos sociais | Plataformas priorizam conteúdo viral | Expansão rápida e sem filtros |

Como a tensão aumentou o alcance do post

O conflito recente entre Estados Unidos e Venezuela já vinha ocupando espaço nas manchetes, portanto o público estava emocionalmente predisposto a acreditar em qualquer nova atualização. Além disso, muitos influenciadores políticos republicaram o conteúdo sem verificar sua origem, acelerando ainda mais a distribuição.

Essa combinação transformou um simples post em um fenômeno global. Além disso, políticos e comentaristas usaram o material para reforçar suas narrativas, mesmo após constatação pública de que o conteúdo era criado por IA.

A crise de confiança no ambiente digital

O caso reacende debates sobre credibilidade, segurança informacional e alfabetização midiática. Embora as plataformas tenham implementado ferramentas de identificação, o público continua vulnerável, principalmente quando o conteúdo aparece em contextos emocionalmente carregados.

Com isso, cresce a percepção de que a confiança digital está em crise. A audiência já não sabe diferenciar material autêntico de produções automatizadas. Portanto, especialistas defendem que os avisos devem ser mais evidentes, além de acompanhados por campanhas educativas.

Por que avisos de IA não estão funcionando

Mesmo que os avisos de IA existam, seu impacto é reduzido. De acordo com pesquisadores:

- muitos usuários não leem legendas ou selos;

- sinais visuais pequenos se perdem na rolagem rápida;

- notificações não explicam o risco envolvido;

- o público confia mais no compartilhamento do que no aviso.

Essa combinação revela que o desafio vai além da tecnologia. É um problema cultural, comportamental e educacional.

Reações de governos e especialistas

Governos e organizações de segurança digital demonstraram preocupação, pois a viralização de conteúdos gerados por IA pode alterar narrativas políticas e influenciar emoções coletivas. Além disso, cresce o debate sobre possíveis regulações para identificar claramente conteúdos sintéticos em períodos de instabilidade internacional.

Especialistas ainda alertam que conflitos geopolíticos costumam ser terreno fértil para campanhas de manipulação, e tecnologias de IA amplificam esse risco.

O que o caso significa para o futuro

O episódio deixa claro que a evolução da IA exige novas estratégias de transparência, educação digital e verificação de autenticidade. Além disso, as plataformas precisam adotar sistemas mais consistentes, como sobreposições obrigatórias e alertas sonoros ou visuais.

Ao mesmo tempo, a sociedade deve desenvolver um olhar mais crítico sobre conteúdos sensíveis, especialmente em momentos de crise política. Assim, cresce a percepção de que a tecnologia sozinha não resolve o problema. A solução exige esforço conjunto entre público, empresas e governos.